现实挑战|智能过滤、隐私共守—冲突与平衡视角下的内容安全研究【安全技术】

- 云服务器供应

- 2025-07-29 09:44:49

- 6

🌐现实挑战|智能过滤、隐私共守——冲突与平衡视角下的内容安全研究【安全技术】

📱场景引入:当“刷脸支付”变成“刷脸风险”

早上7点,你像往常一样在楼下便利店用“刷脸”买了杯咖啡,屏幕一闪,支付成功,但你可能不知道,刚刚那张高清人脸照片已被系统悄悄提取了虹膜特征,甚至可能被用于某个地下市场的“身份冒用”交易,2025年的今天,AI技术让内容安全与隐私保护的博弈进入了深水区——我们享受着智能过滤带来的便利,却也暴露在数据泄露的阴影下。

🔍智能过滤:便利背后的“暗战”

-

技术狂飙,但漏洞如影随形

2025年,智能过滤技术已渗透到生活的方方面面:从社交媒体的涉黄涉政内容拦截,到工业领域的精密液体过滤(如半导体制造中0.05μm级超滤技术),甚至你家的净水器都在用AI算法优化过滤参数,但问题也随之而来——某AI模型曾因数据库配置错误泄露用户聊天记录,类似事件让“智能”二字蒙上阴影。 -

过滤的边界在哪里?

当AI能精准识别“违规内容”时,是否也会误伤合法表达?某短视频平台曾因算法误判,将用户分享的科普视频标记为“伪科学”,引发舆论风波,更令人担忧的是,某些国家开始用“内容安全”之名行审查之实,技术中立性遭遇空前挑战。

🔒隐私共守:一场“技术+法律”的双重博弈

-

法律亮剑,但执行难

2025年,《数据安全法》《个人信息保护法》等法规已细化到数据分类分级、跨境流动规则,但现实是,某电商平台仍被曝出通过“大数据杀熟”侵犯用户隐私,而监管部门因技术手段滞后,往往只能“事后追责”。

-

隐私计算:技术派的突围

差分隐私、联邦学习等技术成为新宠,某医疗AI通过联邦学习训练模型,各医院数据不出库就能完成协作,既保证了数据安全,又提升了诊断准确率,但技术并非万能——某厂商宣称的“匿名化处理”被曝出可通过数据融合还原用户身份,隐私保护仍需“技术+管理”双管齐下。

⚖️冲突与平衡:在夹缝中寻找最优解

-

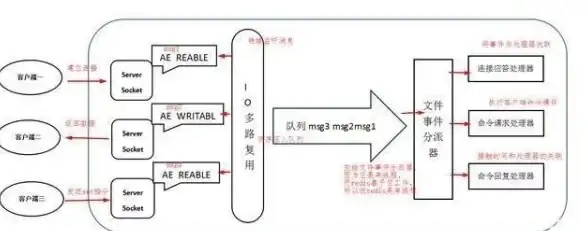

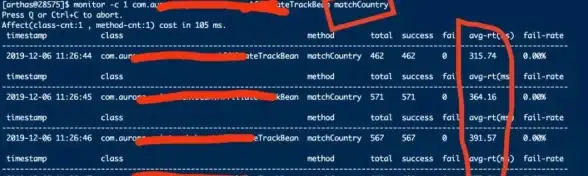

零信任架构:从“信任到验证”的范式转变

2025年,零信任模型成为企业安全标配,某银行通过零信任架构,将内部系统访问权限动态分级,员工登录需通过多因素认证+设备指纹验证,黑客即使盗取账号也无法横向移动。 -

AI治理:用魔法打败魔法

面对AI生成的深度伪造内容,某安全团队开发出“AI鉴伪师”,通过分析面部微表情、语音频谱等特征,识别准确率达98%,欧盟GDPR与中国《网络安全法》联动,要求生成式AI服务必须标注“内容由AI生成”,避免虚假信息泛滥。

-

用户觉醒:从“被动接受”到“主动防御”

用户开始用脚投票:某社交平台因隐私条款模糊,用户流失率飙升30%,更多人选择使用加密通讯工具,甚至有人开发出“隐私健康检查”小程序,一键检测APP权限滥用情况。

在冲突中走向共生

2025年的内容安全战场,已不再是简单的“技术对抗”,而是法律、伦理、商业利益的复杂交织,或许正如某安全专家所说:“智能过滤与隐私保护不是非此即彼的选择,而是需要像DNA双螺旋一样,在冲突中螺旋上升。”

💡行动建议

- 企业:将零信任架构纳入顶层设计,定期做“安全体检”。

- 用户:养成“三问授权”习惯——为何收集数据?如何存储?风险几何?

- 监管:推动AI安全标准国际互认,避免“技术孤岛”。

在这个“万物皆可过滤”的时代,我们既要享受技术红利,也要警惕成为“透明人”,毕竟,安全与自由的平衡,才是数字文明的终极命题。🌐

本文由 业务大全 于2025-07-29发表在【云服务器提供商】,文中图片由(业务大全)上传,本平台仅提供信息存储服务;作者观点、意见不代表本站立场,如有侵权,请联系我们删除;若有图片侵权,请您准备原始证明材料和公证书后联系我方删除!

本文链接:https://vps.7tqx.com/fwqgy/474844.html

发表评论